Il progetto AI-MOKa, dello Spoke 2 di RAISE, è stato così sintetizzato da uno dei ricercatori coinvolti, Ludovico Pedullà (Fondazione Italiana Sclerosi Multipla):

“La sclerosi multipla (SM) è una patologia cronica, neuro-degenerativa, che può dare esito ad un ampio spettro di sintomi. È importante il monitoraggio delle persone con SM durante le attività di vita quotidiana. All’interno del progetto RAISE, abbiamo messo in piedi un set-up sperimentale in cui viene richiesto di eseguire un compito (task) culturalmente importante, come quello di fare un caffè, mentre si indossa della tecnologia. Abbiamo scelto questa attività perché richiede sia funzioni motorie che cognitive”.

Tale progetto è entrato in una nuova fase di sviluppo. I ricercatori e tecnici di RAISE hanno introdotto degli importanti elementi di novità:

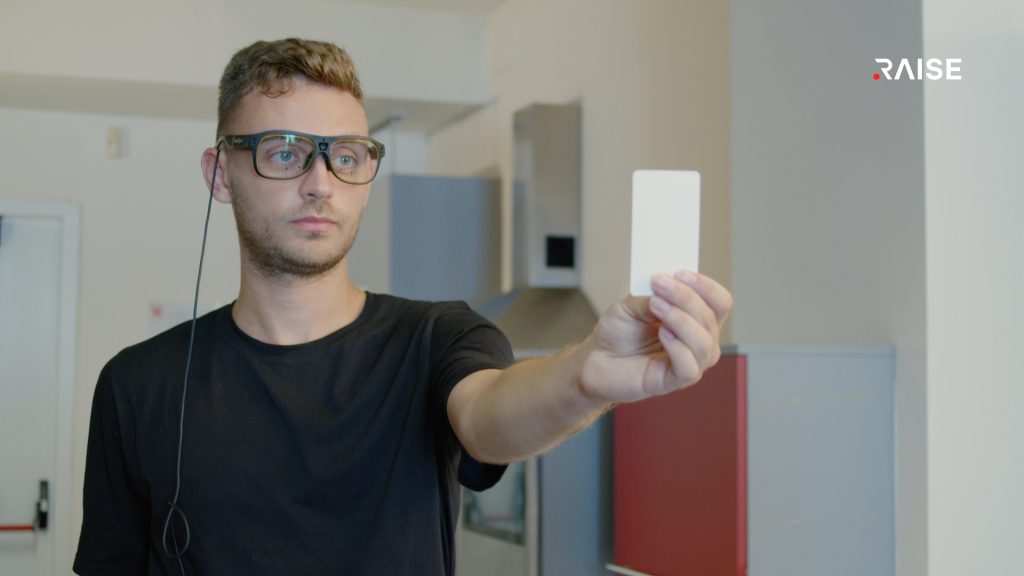

1) integrazione di diversi dispositivi; oltre agli occhiali per il tracciamento dello sguardo, sono state utilizzate anche solette che permettono di misurare parametri di equilibrio e cammino durante il compito;

2) segmentazione automatica dell’azione, utilizzando QR code posti su oggetti e ambienti;

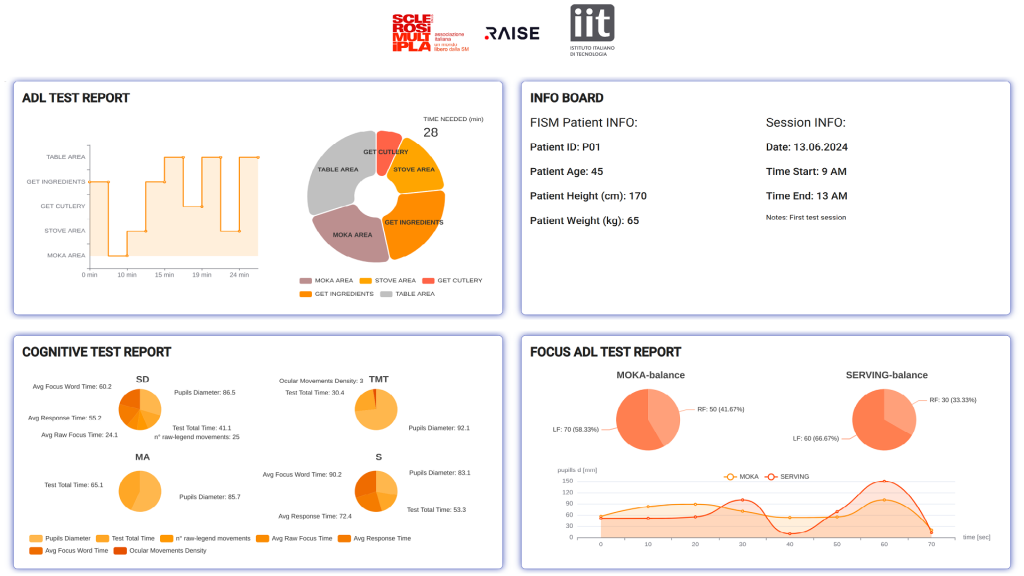

3) prime elaborazioni dei dati e generazione di un report di facile lettura che consenta a pazienti e clinici di visualizzare i risultati della prestazione.

Presso la sede della Fondazione Italiana Sclerosi Multipla (FISM) di Genova, proseguono quindi dei test preliminari per valutare l’attività di preparazione del caffè, utilizzando sensori indossabili e algoritmi di Intelligenza Artificiale (IA).

Nel più recente test, una parte del gruppo di ricerca di AI-MOKa, Erica Grande (FISM), con Giulia Bodo (IIT) insieme a Giulio Sciortino (IIT) hanno così commentato le attività attualmente in corso e i relativi risultati.

Giulia Bodo (IIT)

“Con il nostro gruppo, ci occupiamo di andare ad integrare i dati provenienti da diversi sensori, per ricostruire quella che è l’attività motorio-cognitiva del soggetto con SM. In particolare, usiamo delle solette sensorizzate, per analizzare la qualità del cammino e la capacità di auto-bilanciarsi del paziente in varie fasi dell’esecuzione del task; quindi, dove l’attenzione richiesta per il task motorio è più o meno elevata”.

La ricercatrice ha poi specificato che questi dati ricavati dalle solette vengono combinati con l’analisi della pupillometria ottenuta dagli occhiali sensorizzati, da cui si ricava il carico cognitivo. Inoltre, il team realizza delle interfacce grafiche, da dare al terapista alla fine della seduta, in modo che ci sia un report dei dati raccolti nella sessione di test.

Giulio Sciortino (IIT)

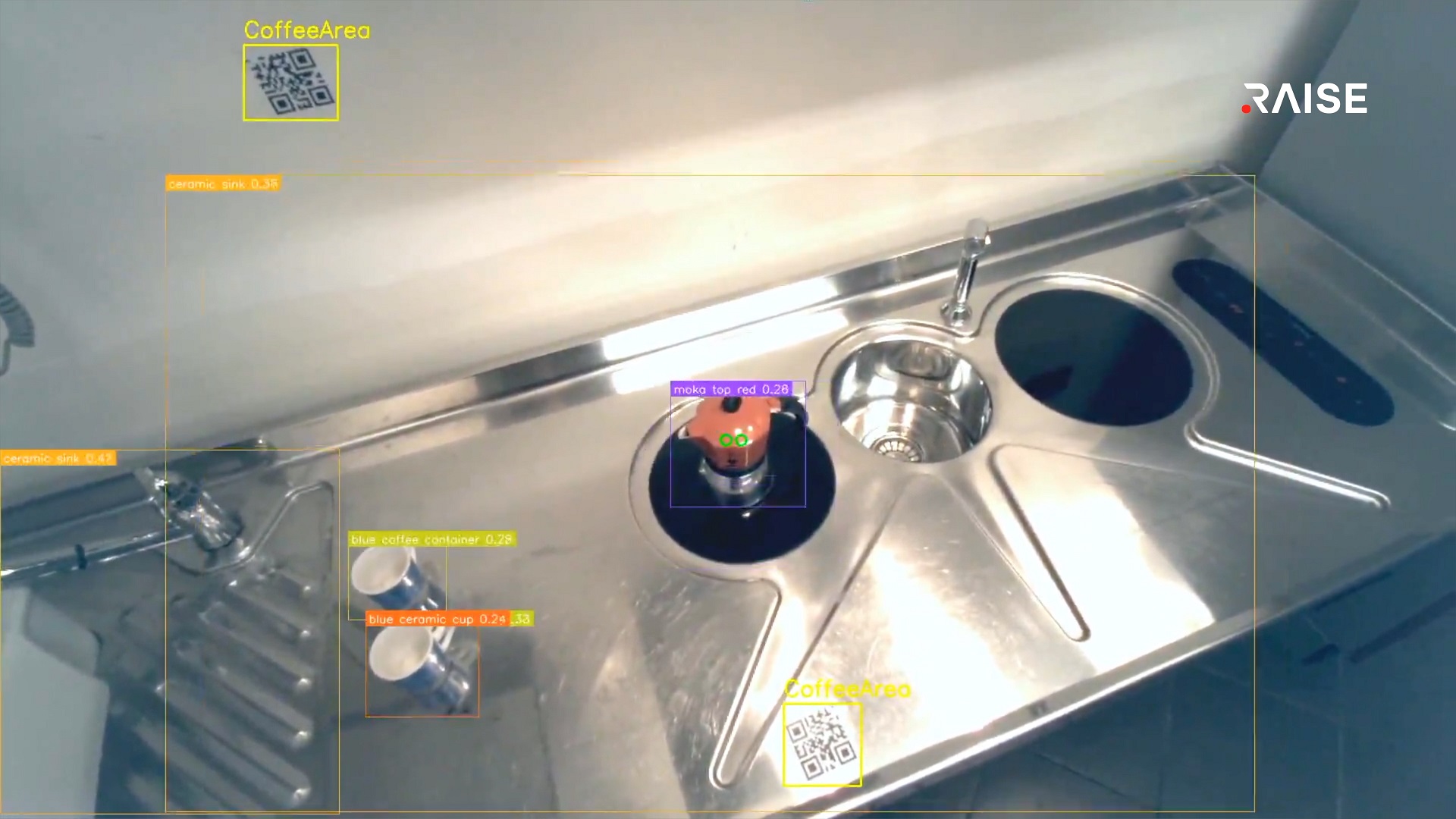

“L’unità di cui faccio parte si occupa di computer vision, ovvero una branca della IA, dedicata alla estrazione di informazioni dalle immagini, che possono essere foto e video. In particolare, nel contesto del progetto RAISE, noi utilizziamo degli occhiali sensorizzati, ovvero occhiali dotati di microtelecamere, che puntano sia agli occhi del paziente che al mondo esterno. Grazie a questi sensori, e grazie agli algoritmi di IA che stiamo utilizzando, riusciamo a ricostruire la direzione dello sguardo, la posizione dello sguardo sugli oggetti e riusciamo a riconoscere gli oggetti e le azioni compiute, in modo tale da estrarre informazioni importanti da comunicare al personale sanitario, che riuscirà così a monitorare la progressione della malattia”.

Erica Grange (FISM)

“Il carattere innovativo di questo user case è l’uso combinato di sensori indossabili e algoritmi di IA durante lo svolgimento di una attività di vita quotidiana. Questo permette di andare a monitorare in maniera precisa e puntuale quelle che sono funzioni cognitive e motorie durante lo svolgimento di attività di vita quotidiana, quindi all’interno di un contesto ecologico e reale. A differenza dei classici test di laboratorio, che consentono di monitorare queste funzioni in maniera isolata o attraverso paradigmi che si allontanano dall’attività quotidiana”.

Il progetto AI-MOKa coinvolge diverse persone del Rehab Technologies Lab (RTECH) e dell’unità Pattern Analysis and Computer Vision (PAVIS) dell’Istituto Italiano di Tecnologia (IIT) e di Fondazione Italiana Sclerosi Multipla (FISM): Matteo Laffranchi, Alessio Del Bue, Giulia Bodo, Alexey Petrushin, Carlos Beltran, Gianluca Bailo, Giulio Sciortino, Giampaolo Brichetto, Ludovico Pedullà, Erica Grange, Andrea Tacchino, Jessica Podda, Alice Bollini.

AI-MOKa è un progetto innovativo di Spoke 2, coordinato da Lorenzo De Michieli (IIT), che mette la tecnologia, come sensori e IA, al servizio delle persone con sclerosi multipla e del personale sanitario, impegnato a studiare la malattia e migliorare la qualità della vita dei loro pazienti.

Immagini:

Credits: FISM, IIT e RAISE

Immagine Copertina:

Elaborazione dei video catturati dagli occhiali sensorizzati tramite algoritmi di IA per il riconoscimento della direzione dello sguardo, degli oggetti presenti nella scena, con cui il soggetto interagisce, e del QR code identificativo della zona della stanza in cui il soggetto si trova.

Autore: Gian Luca Bailo (IIT PAVIS)